Om faktaarket

Formålet med faktaarket er å gi en oversikt over følgende krav i KI-forordningen:

- Krav til KI-systemer med høy risiko

- Krav til leverandører av KI-systemer med høy risiko

- Krav til idriftsettere av KI-systemer med høy risiko

- Krav til leverandører av KI-modeller for allmenne formål

Relevante lenker

- Høring – utkast til ny lov om kunstig intelligens – gjennomføring av EUs forordning om kunstig intelligens i norsk rett - regjeringen.no

- https://ai-watch.ec.europa.eu/news/harmonised-standards-european-ai-act-2024-10-25_en

- CEN-CENELEC-JTC21-AI-Standards-Complete-Detailed-Overview.pdf

- The General-Purpose AI Code of Practice | Shaping Europe’s digital future

KI-forordningen

Forslag til ny lov om kunstig intelligens (KI-loven) ble sendt på høring sommeren 2025. KI-loven skal gjennomføre KI-forordningen i norsk rett. Det tas sikte på at reglene i forordningen skal gjelde i Norge fra og med august 2026 (1).

Faktaarket gir ikke en uttømmende fremstilling av de ovennevnte kravene i forordningen, men en oversikt over hovedtrekkene. Kravene må ses i sammenheng med annet harmoniserende EU-regelverk, f.eks. forordning om medisinsk utstyr og nasjonalt regelverk, f.eks. helsepersonelloven og pasient- og brukerrettighetsloven, se også Regelverket for utvikling av kunstig intelligens - Helsedirektoratet og Spørsmål og svar fra veiledningstjenesten - Helsedirektoratet.

Kort om formålet med KI-forordningen

EUs forordning om kunstig intelligens (KI-forordningen) skal fremme og øke bruk av menneskesentrerte og trygge KI-systemer, samt forskning og innovasjon. Forordningen skal videre sikre et høyt nivå av beskyttelse av helse, sikkerhet og grunnleggende friheter, inkludert demokrati, rettssikkerhet og miljø, mot skadelige effekter KI-systemer kan ha.

Forordningen vil gjelde for alle KI-systemer som berører borgere i EU/EØS og pålegger blant annet leverandører og idriftsettere av KI-systemer, samt leverandører av KI-modeller for allmenne formål, en rekke forpliktelser.

Risikobasert tilnærming til regulering av KI-systemer

Relevante artikler i forordningen: 5-7, 50 og 95

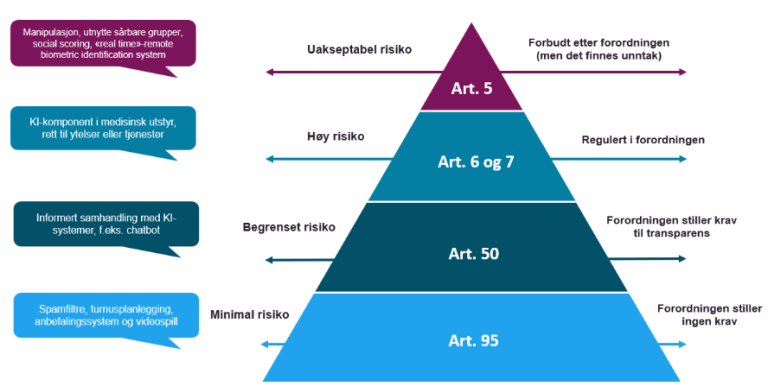

Forordningen har en risikobasert tilnærming, der hvert KI-system klassifiseres etter risikonivå som har betydning for hvilke krav en leverandør og idriftsetter skal følge. Klassifisering av risiko skal baseres på den tiltenkte bruken av KI-systemet og risikoklassene er delt inn i minimal, begrenset, høy og uakseptabel risiko.

KI-systemer med uakseptabel risiko er, med enkelte unntak, forbudt etter forordningen. For KI-systemer med begrenset risiko stilles det kun krav om transparens, noe som innebærer at idriftsetter må sørge for at de som samhandler med KI-systemet får informasjon om dette. For KI-systemer med minimal risiko stilles det ingen krav, men det oppfordres til bruk av frivillige etiske retningslinjer, slik som for eksempel bransjenormer (Codes of conduct). Det er imidlertid KI-systemer med høy risiko som hovedsakelig reguleres i forordningen.

Krav til KI-systemer med høy risiko

Relevante artikler i forordningen: artikkel 8-15 og 40

Forordningen viser til en rekke eksempler der KI-systemer beregnet til bruk på helseområdet utgjør høy risiko. For eksempel når KI-systemer er beregnet for bruk i medisinsk utstyr i klasse IIa og oppover. Videre når KI-systemer benyttes av offentlig myndigheter, eller på vegne av det offentlige, for å vurdere enkeltpersoners rett til nødvendige offentlige tjenester, inkludert helsetjenester, samt det å tildele, redusere, tilbakekalle eller kreve tilbake slike tjenester. Det vises også til bruk av KI-systemer i forbindelse med nødanrop og triagering. For disse KI-systemene gjelder en rekke krav.

For det første skal et KI-system med høy risiko være underlagt et risikostyringssystem så lenge KI-systemet blir brukt. Det stilles krav til håndtering av data som skal brukes til trening, validering og testing av KI-systemet, herunder relevans, representativitet og risiko for bias. Dersom det behandles personopplysninger, må det for eksempel skje i tråd med reglene i personvernforordningen.

Videre stilles det krav til å dokumentere hvordan KI-systemet fungerer, og dokumentasjonen skal blant annet sette vedkommende myndigheter og meldte organer i stand til å vurdere om reglene i forordningen etterleves. KI-systemet skal inneholde en teknisk funksjonalitet for automatiske hendelseslogger, samt være transparent og ha passende grad av åpenhet og gjennomsiktighet. Med andre ord skal det være mulig å forstå hvordan KI-systemet fungerer, herunder systemets styrker og svakheter.

I forlengelsen av dette stilles det blant annet krav til at systemet må ha en bruksanvisning som er kortfattet, klar, korrekt og fullstendig. Videre skal KI-systemer designes og utvikles på en måte som gjør det mulig for mennesker å overvåke og kontrollere dem under bruk. Dette er et viktig krav som skal sikre at helse, sikkerhet og andre grunnleggende rettigheter blir ivaretatt når KI-systemet tas i bruk. Videre skal robusthet, nøyaktighet og cybersikkerhet være på et passende nivå sett i sammenheng med KI-systemet.

Det legges opp til utstrakt bruk av harmoniserte standarder i forordningen. Ved å følge disse standardene vil KI-systemet i utgangspunktet anses for å være i samsvar med kravene i forordningen (2 og 3).

Krav til leverandører av KI-systemer med høy risiko

Relevante artikler i forordningen: 16-21, 43, 47-49 og 71

Leverandører må påse at de ovennevnte kravene til KI-systemer med høy risiko blir ivaretatt. Forordningen stiller videre krav til at det må etableres et kvalitetssikringssystem. Det stilles krav til å utarbeide teknisk informasjon som oppbevares i 10 år og krav til automatisk generering av hendelseslogger, som skal oppbevares i minst 6 måneder. Både teknisk informasjon og hendelseslogger skal være tilgjengelige for vedkommende myndigheter.

Forordningen angir hvordan leverandøren skal gå frem dersom et KI-system ikke er i samsvar med kravene i forordningen, eller bruk av systemet anses å utgjøre en risiko, samt krav til samarbeid med vedkommende myndigheter for øvrig. Videre må leverandøren sørge for nødvendige samsvarsvurderinger og CE-merkinger. I tillegg er leverandøren ansvarlig for å registrere KI-systemet i EUs database som opprettes med hjemmel i forordningen for å få en oversikt over disse systemene.

Krav til idriftsettere av KI-systemer med høy risiko

Relevante artikler i forordningen: 25-27, 49, 71, 72 og 79

Når et KI-system tas i bruk, er idriftsetter pålagt å gjennomføre tekniske og organisatoriske tiltak i tråd med bruksanvisning fra leverandøren. Idriftsetteren må også gjennomføre tiltak for å sikre menneskelig overblikk og kontroll. Dette innebærer for eksempel å sikre at ansatte som skal bruke systemet, har relevant kompetanse og får nødvendig opplæring for å forstå og håndtere systemets funksjoner. Idriftsetter er også underlagt krav om overvåking av systemet.

Videre må idriftsetter sørge for at input-data som legges inn i KI-systemet er relevante og representative for det tiltenkte formålet med bruken. Idriftsetter skal etablere automatisk generering av hendelseslogger og oppbevare disse i minst 6 måneder. Forordningen angir også her hvordan idriftsetter skal gå frem dersom bruk av KI-systemet i tråd med bruksanvisningen utgjør en risiko, typisk dersom dette bidrar til at det oppstår et avvik eller en alvorlig hendelse, og krav til samarbeid med vedkommende myndigheter for øvrig.

Dersom KI-systemet brukes på en arbeidsplass er idriftsetter, som arbeidsgiver, forpliktet til å informere både arbeidstakernes representanter og berørte arbeidstakere om bruken av systemet. Der KI-systemet blir brukt som beslutningsstøtte eller til å treffe helautomatisert avgjørelser skal de berørte få informasjon. Når en idriftsetter er en offentlig myndighet, er de ansvarlige for å registrere bruk av KI-systemet i EUs database.

I kravene som oppstilles for idriftsetter er det inntatt en henvisning til kravet om å gjennomføre en personvernkonsekvensvurdering (DPIA) etter personvernforordningen. Det er også inntatt et krav om å gjennomføre en vurdering av konsekvenser for grunnleggende rettigheter ved bruk av høyrisikosystemer (Fundamental rights impact assessment, FRIA), med enkelte unntak. Dette er en vurdering som skal hjelpe idriftsetter med å kartlegge hvilke mulige negative konsekvenser et KI-system med høy risiko kan ha for grunnleggende rettigheter, som f.eks helse og sikkerhet.

Det stilles blant annet krav til FRIA når offentlige eller private aktører skal bruke KI-systemer for å yte offentlige tjenester. FRIA har flere likhetstrekk med DPIA, og forordningen legger opp til at vurderinger fra en DPIA kan gjenbrukes i en FRIA. Europakommisjonen skal utvikle retningslinjer for slike vurderinger.

Merk at mange av kravene til leverandør og idriftsetter er like, og det er viktig å merke seg at roller og ansvar kan endres etter at KI-system er tatt i bruk. Dette innebærer at en idriftsetter kan gå over til å bli leverandør av et KI-system, f.eks dersom de bruker det til andre formål enn det som opprinnelig var tiltenkt eller gjør betydelige endringer i systemet som medfører at KI-systemet anses å ha høy risiko. De vil da bli forpliktet til å følge kravene som stilles til leverandører etter forordningen.

Krav til leverandører av KI-modeller for allmenne formål

Relevante artikler i forordningen: 3 nr. 63-67, 40, 51-53, 55 og 56.

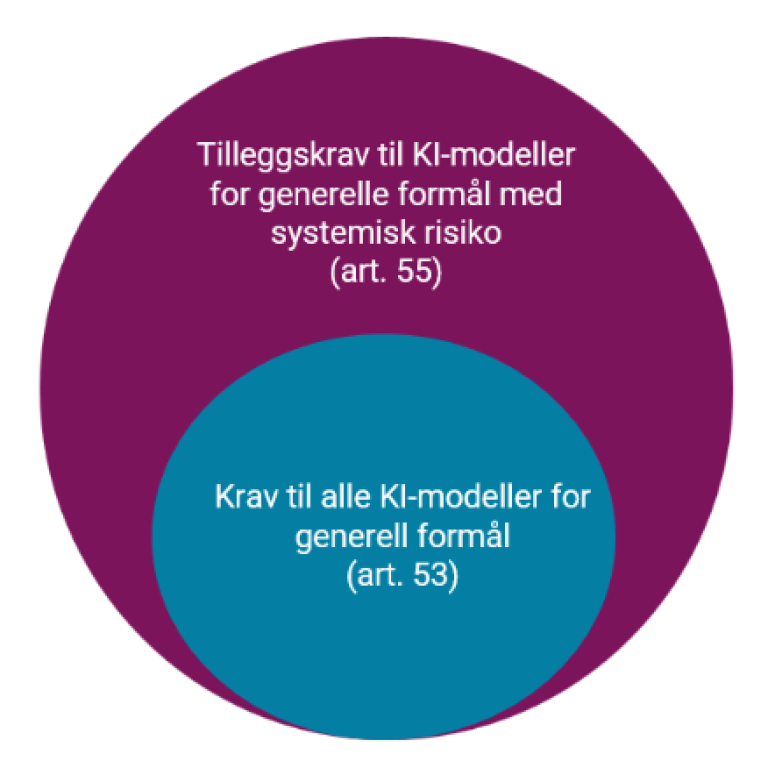

For KI-modeller for allmenne formål (General purpose AI/GPAI), som for eksempel språkmodeller slik som ChatGPT mfl., er det i likhet med KI-systemer, en risikobasert tilnærming til reguleringen. En KI-modell er ikke et selvstendig KI-system, men noe et KI-system er bygget på eller integreres i.

KI-modeller for allmenne formål er spesielt regulert i KI-forordningen på grunn av deres generelle anvendbarhet og evne til å utføre et bredt spekter av forskjellige oppgaver med ulike formål, noe som skaper utfordringer knyttet til risikovurdering og ansvarsfordeling mellom leverandører og brukere av modellene.

Utgangspunktet er at leverandører av slike KI-modeller er pålagt krav etter forordningen. Dersom det er tale om en KI-modell med systemisk risiko, vil det også utløses noen tilleggskrav. En KI-modell for allmenne formål har systemisk risiko dersom den har høy påvirkningsevne, eksempelvis at den har evne til å påvirke valg, essensielle tjenester som vann og avløp, strålevern og atomberedskap. Forordningen angir ulike metoder som kan brukes for å vurdere om KI-modell har høy påvirkningsevne.

For leverandører av KI-modeller gjelder mange av de samme kravene som det stilles til KI-systemer med høy risiko. Blant annet må leverandøren utarbeide teknisk informasjon som beskriver hvordan KI-modellen fungerer, KI-modellen skal ha et passende nivå av cybersikkerhet og det skal gjennomføres evalueringer, herunder risikovurderinger og settes inn risikoreduserende tiltak.

Den tekniske informasjonen skal deles med andre leverandører som ønsker å integrere KI-modellen i sine produkter, og produsenten er pålagt å offentliggjøre en oppsummering av data som er brukt for å trene opp KI-modellen.

Videre er det inntatt krav til å følge regler om beskyttelse av forretningshemmeligheter, fortrolig forretningsinformasjon og immaterielle rettigheter i henhold til EU-rett og nasjonal rett, og leverandøren må utarbeide en Policy knyttet til dette. Dersom det oppstår en alvorlig hendelse skal leverandøren rapportere til Europakommisjonens AI-kontor og nasjonale tilsynsmyndigheter, samt samarbeide med disse organene når de utøver sin kompetanse og myndighet etter forordningen. AI-kontoret har publisert retningslinjer (Codes of Practice) for leverandører av KI-modeller (4).

Som nevnt over vil det utløses tilleggskrav dersom en KI-modell har systemisk risiko. Leverandøren er pålagt å evaluere KI-modellen i henhold til standardiserte protokoller og egnede verktøy, herunder gjennomføre og dokumentere trening og test for å identifisere risiko og iverksette risikoreduserende tiltak.

Videre må det vurderes om det foreligger systemisk risiko på EU-nivå, som betyr at KI-modellen utgjør en risiko på tvers av landegrenser og har evne til å påvirke EU i sin helhet. Også for KI-modeller med systemisk risiko er det etablert en plikt for leverandørene til å rapportere til Europakommisjonen og AI-kontoret.

Også her legger forordningen opp til utstrakt bruk av harmoniserte standarder. Ved å følge disse standardene vil KI-modeller i utgangspunktet anses for å være i samsvar med kravene i forordningen.